Deepfake-Stimmen: So erkennt unser Gehirn den Unterschied

Macht das Gehirn beim Verarbeiten von natürlichen Stimmen im Vergleich zu ihren Deepfake-Imitationen einen Unterschied? Ja, sagt eine neue Studie der Universität Zürich. Es lassen sich zwei Hirnareale identifizieren, die unterschiedlich auf die akustischen Signale reagieren.

Foto: panthermedia.net/Rockvel

Jeder Mensch hat ein einzigartiges Stimmprofil. Es hilft uns, Personen zu identifizieren. Neueste Algorithmen für die Stimmsynthese sind so leistungsfähig, dass die Stimmklone, die sie erstellen, den natürlichen Stimmen sehr nahekommen. Noch nie war es so leicht, mit Deepfake-Technologien Stimmen zu imitieren.

Bisher war unklar, wie das Gehirn auf solche Deepfake-Stimmen reagiert. Sagt es uns: „Das ist echt“? Oder erkennt es den Fake? Ein Forschungsteam der Universität Zürich hat herausgefunden, dass Menschen die geklaute Identität in einem Deepfake-Audio oft als natürlich akzeptieren. Trotzdem: Unser Gehirn merkt, dass da was nicht stimmt. Es reagiert anders auf Deepfake-Stimmen als auf natürliche Stimmen.

Täuschend echt? Deepfake-Stimmen und das Gehirn

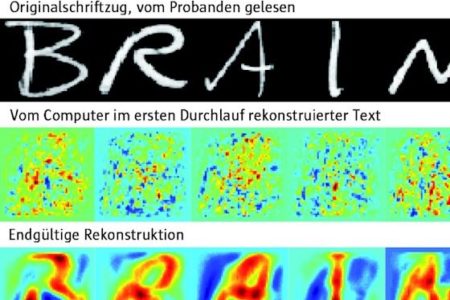

Die Forscherinnen und Forscher testeten mit psychoakustischen Methoden, wie gut die menschliche Identität in den imitierten Stimmklonen erhalten bleibt. Sie nahmen vier männliche Sprecher auf und generierten Deepfake-Stimmen ihrer Stimmen. Im Hauptexperiment hörten 25 Probandinnen und Probanden mehrere Stimmen. Sie sollten entscheiden, ob die Identität zweier Stimmen identisch war oder nicht. Dabei gab es zwei Aufgaben: Entweder sollten sie die Identität von zwei natürlichen Stimmen oder einer natürlichen und einer Deepfake-Stimme abgleichen.

Es zeigte sich, dass die Deepfake-Stimmen in zwei Dritteln der Fälle korrekt zugeordnet wurden. „Dies verdeutlicht, dass aktuelle Deepfake-Stimmen zwar nicht perfekt die Identität imitieren, aber das Potenzial haben, die Wahrnehmung von Menschen zu täuschen“, sagt die Neuro- und Sprachwissenschaftlerin Claudia Roswandowitz vom Institut für Computerlinguistik.

Deepfake-Erkennung: Belohnungssystem im Gehirn auf dem Prüfstand

Mit bildgebenden Verfahren untersuchten die Forschenden dann, welche Gehirnareale abweichend auf Deepfake-Stimmen im Vergleich zu natürlichen Stimmen reagieren. Sie fanden zwei zentrale Areale, die den Fake erkennen: den Nucleus accumbens und den auditorischen Cortex.

Zum einen reagiert ein Teil des mesolimbischen Systems, der Nucleus accumbens, anders auf Deepfake-Stimmen. „Der Nucleus accumbens ist ein wichtiger Bestandteil des Belohnungssystems im Gehirn. Er war weniger aktiv, als die Probandinnen und Probanden die Identität zwischen Deepfake und natürlichen Stimmen abgleichen sollten“, erklärt Roswandowitz. Der Nucleus accumbens war viel aktiver, wenn die Probandinnen und Probanden zwei natürliche Stimmen vergleichen mussten.

Deepfake-Stimmen machen offenbar weniger Spaß und das ist relativ unabhängig von der Qualität des akustischen Signals. „Der Mensch kann also nur teilweise durch Deepfakes getäuscht werden“, folgert Roswandowitz. Sie spricht von einer menschlichen Widerstandsfähigkeit gegenüber gefälschten Informationen, die uns im Alltag immer häufiger begegnen.

Deepfake: Der Klangdetektiv im Gehirn erkennt die falschen Stimmen

Das zweite Hirnareal, das im Experiment aktiv war, ist der auditorische Cortex. Dieser ist zuständig für die Analyse von Geräuschen. Er war aktiver, als es die Identität zwischen Deepfake und natürlicher Stimme abzugleichen galt. „Wir vermuten, dass dieses Areal auf die noch nicht perfekte akustische Imitation der Deepfake-Stimmen reagiert“, so die Forscherin. Unser Hirn merkt also: Da stimmt was nicht. Als Reaktion versuche dann der auditorische Cortex das fehlende akustische Signal auszugleichen, so Roswandowitz. Je weniger natürlich und sympathisch die gefälschte Stimme im Vergleich zur natürlichen Stimme wahrgenommen wurde, desto größer waren die Aktivitätsunterschiede im auditorischen Cortex.