Studie deckt Sicherheitsrisiken beim Einsatz öffentlicher KI auf

Unternehmen scheinen sich der Risiken bei der Verwendung frei zugänglicher KI nicht bewusst zu sein. Eine aktuelle Studie zeigt, woran Vorgaben im Datenschutz scheitern.

Foto: PantherMedia / biancoblue

Mal eben schnell ein Dokument übersetzen oder eine Folie für die nächste Vorstandspräsentation optimieren: Dank frei zugänglicher KI-Lösungen scheint das kein Problem mehr zu sein. Problematisch kann es allerdings werden, wenn die Vorlagen Einblicke in sensible Unternehmensprozesse und Kundendaten enthalten.

Eine Umfrage der Shamundi Consulting in Zusammenarbeit mit der International School of Management (ISM) und vier deutschen Technologieunternehmen unter der Leitung von Kishor Sridhar sollte darüber Aufschluss geben. Der ISM-Dozent für Wirtschaftspsychologie mit Schwerpunkt auf den Themen New Work und Führung befragte mit seinem Team 750 Führungskräfte in deutschen Unternehmen zu ihrer KI-Nutzung. Das Ergebnis: Im Umgang mit frei zugänglichen KI-Lösungen liegt ein großes Datenschutzrisiko in deutschen Unternehmen.

Datenschutz beim Einsatz von KI erfordert Aufklärung bei den Beschäftigten

Obwohl dem Datenschutz in Europa ein großer Stellenwert beigemessen wird, scheinen sich Anwender in Unternehmen darüber wenig Gedanken zu machen, wenn es um Risiken im Zusammenhang mit frei zugänglicher KI geht. Darauf deuten die Erkenntnisse der Studie hin. Und auch die Aufklärung der Beschäftigten komme in der Wahrnehmung der Befragten bislang zu kurz.

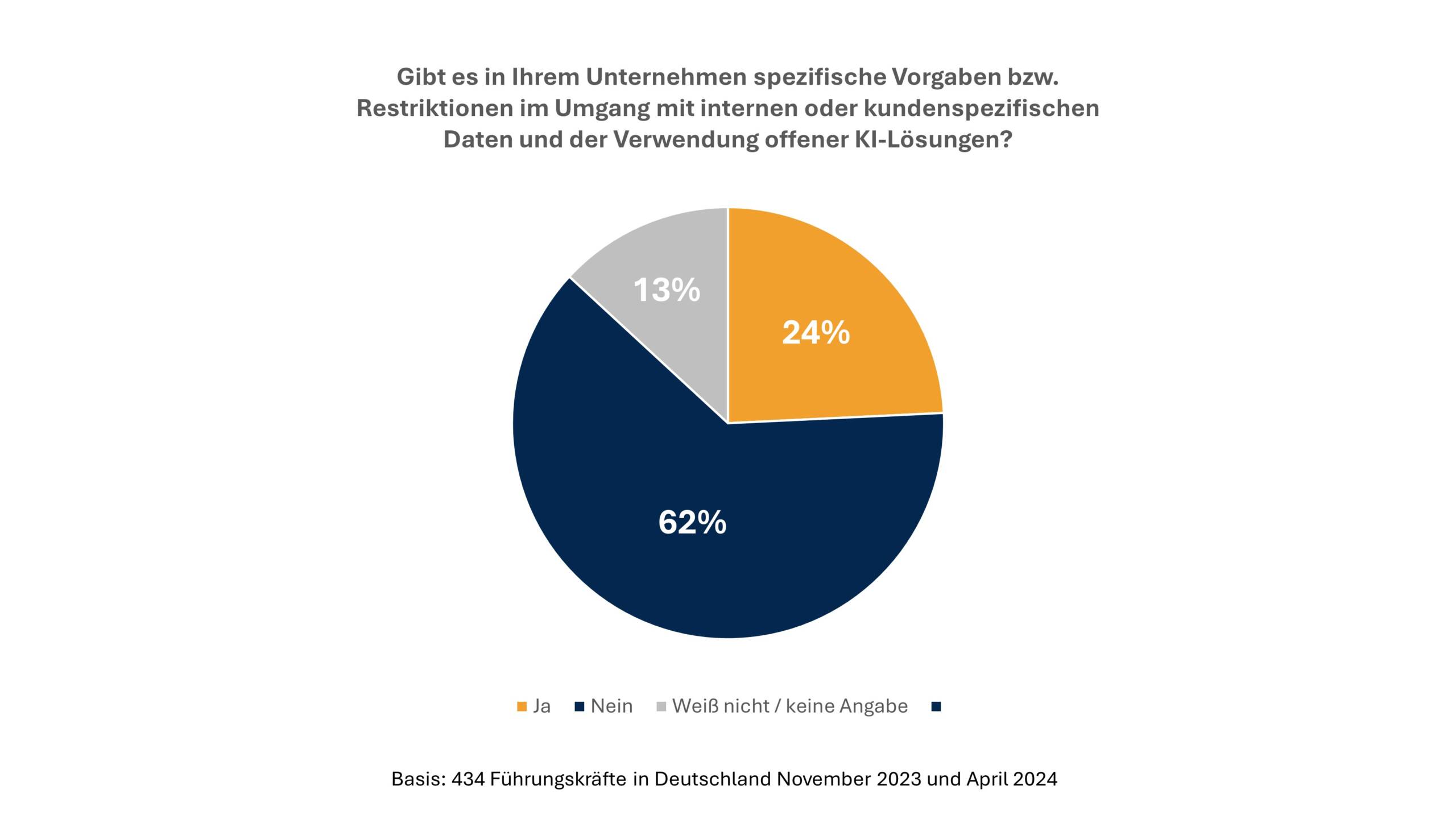

Fast zwei Drittel (62 %) der befragten Führungskräfte gaben an, dass es in ihrem Unternehmen keine spezifischen Vorgaben bzw. Restriktionen im Umgang mit internen oder kundenspezifischen Daten im Zusammenhang mit der Verwendung offener KI-Systeme gibt. Nur 24 % berichteten, über solche Vorgaben zu verfügen. Weitere 13 % konnten darüber keine Angaben machen oder waren sich nicht sicher.

Frei zugängliche KI wird bei der Mehrheit der Unternehmen gern genutzt – teilweise sogar täglich

Folgende Zahlen belegen die Krux: Zwar sind interne KI-Lösungen laut der Studie bereits bei 31 % der Befragten fest implementiert. Wesentlich verbreiteter ist aber die Arbeit mit frei zugänglichen KI-Lösungen wie ChatGPT oder Claude.ai. Die Mehrheit (58 %) der Befragten gab an, dass sie solche Lösungen für berufliche Zwecke nutzt. Auch über die Anwendungszwecke gibt die Studie Aufschluss. Die häufigsten Anwendungen waren demnach das Korrekturlesen bzw. Lektorieren von Texten (68 %) sowie die Ideen- oder Informationsgewinnung (54 %). Mehr als ein Viertel der Befragten (26 %) nutzt diese Systeme allerdings auch für die Aufbereitung von Daten.

Erschreckend für die Wissenschaftler: Auf die Frage, wie häufig sie interne Unternehmensdaten oder -informationen bzw. Kundendaten oder -informationen an frei zugängliche KI-Lösungen weitergegeben haben, gaben 8 % an, dies täglich zu tun. Weitere 21 % taten dies mehrmals wöchentlich und 29 % mindestens einmal im Monat. „Das stellt ein erhebliches Sicherheitsrisiko für deutsche Unternehmen dar“, betont Kishor Sridhar. Dabei gaben 24 % der Befragten an, dass es klare Vorgaben im Umgang mit Daten bei der Verwendung von frei zugänglichen KI-Lösungen gab. 23 % der Teilnehmenden fühlten sich hinsichtlich des Datenschutzes im Umgang mit frei zugänglichen KI-Lösungen nicht ausreichend informiert.

Positiv bewertet das Forscherteam, dass es aber bei den Führungskräften zumindest eine Grundsensibilität für die Risiken gibt. Denn 34 % räumten ein, dass sie schon einmal sensible Daten und Informationen bewusst nicht an frei zugängliche KI-Systeme gegeben haben, weil sie Bedenken hinsichtlich des Datenschutzes hatten.

Datenschutz und KI: DSGVO-Vorgaben reichen allein nicht aus

Sridhar resümiert deshalb: „Grundsätzlich zeigt diese Studie, dass interne Vorgaben und DSGVO-Vorgaben nicht ausreichen, da weitestgehend sorglos auch sensibelste Unternehmens- und Kundendaten an frei zugängliche, externe KI-Lösungen weitergegeben werden.“ Er ergänzt, dass die Datenschutzproblematik noch dadurch verstärkt werde, dass nicht klar nachvollziehbar sei, wie KI-Lösungen insgesamt Daten verarbeiteten. „Die Ergebnisse der Umfrage unterstreichen die Notwendigkeit verstärkter Anstrengungen seitens der Unternehmen und der Gesetzgeber. Es bedarf klarer Richtlinien und regelmäßiger Überprüfungen, um sicherzustellen, dass alle Unternehmen die notwendigen Schritte zur Einhaltung der Datenschutzbestimmungen unternehmen“, lautet seine Schlussfolgerung.